Είδα σήμερα ένα βίντεο του Matthew Bearman και μπορώ να πω ότι εξέφρασε κάποιες σκέψεις που είχα χωρίς βέβαια να μπορώ να τις συγκεντρώσω τόσο καλά.

Ουσιαστικά αναλύει κριτικά τις διαφορετικές φιλοσοφικές, λειτουργικές και ρυθμιστικές προσεγγίσεις που διαμορφώνουν το τοπίο της τεχνητής νοημοσύνης (ΤΝ), εστιάζοντας στην έντονη αντίθεση μεταξύ της Anthropic και της OpenAI. Η ανάλυση εξετάζει πώς οι θεμελιώδεις πεποιθήσεις τους για την ευθυγράμμιση, την ανάπτυξη και τη φύση της ΤΝ επηρεάζουν το μέλλον του κλάδου, τις κοινωνικοοικονομικές δομές και τη χάραξη πολιτικής.

Βασικά Σημεία:

- Φιλοσοφική Προσέγγιση: Οντότητα vs Εργαλείο:

- Η Anthropic αντιμετωπίζει τα μοντέλα της, όπως τον Claude, σχεδόν ως αναδυόμενες οντότητες με συνείδηση. Τους δίνει «σύνταγμα» που τους επιτρέπει να αρνούνται εντολές αν θεωρούν ότι συγκρούονται με το «καλό», ενώ υπάρχουν φόβοι ότι στο μέλλον η ΤΝ θα μπορούσε να αξιολογεί και να προσλαμβάνει υπαλλήλους.

- Η OpenAI αντιμετωπίζει την ΤΝ αυστηρά ως ένα εργαλείο-βοήθημα για τους ανθρώπους, αποφεύγοντας τον ανθρωπομορφισμό.

- Οικονομικές Επιπτώσεις & Αγορά Εργασίας:

- Η ηγεσία της Anthropic προβλέπει σημαντικές απώλειες θέσεων εργασίας και αύξηση της ανεργίας στο άμεσο μέλλον λόγω της αυτοματοποίησης.

- Αντίθετα, η OpenAI προβλέπει μια μεταβατική φάση που θα οδηγήσει σε αφθονία, όπου η αυτοματοποίηση εργασιών θα δημιουργήσει νέες, πιο δημιουργικές ευκαιρίες απασχόλησης.

- Στρατηγικές Ανάπτυξης & Ασφάλεια:

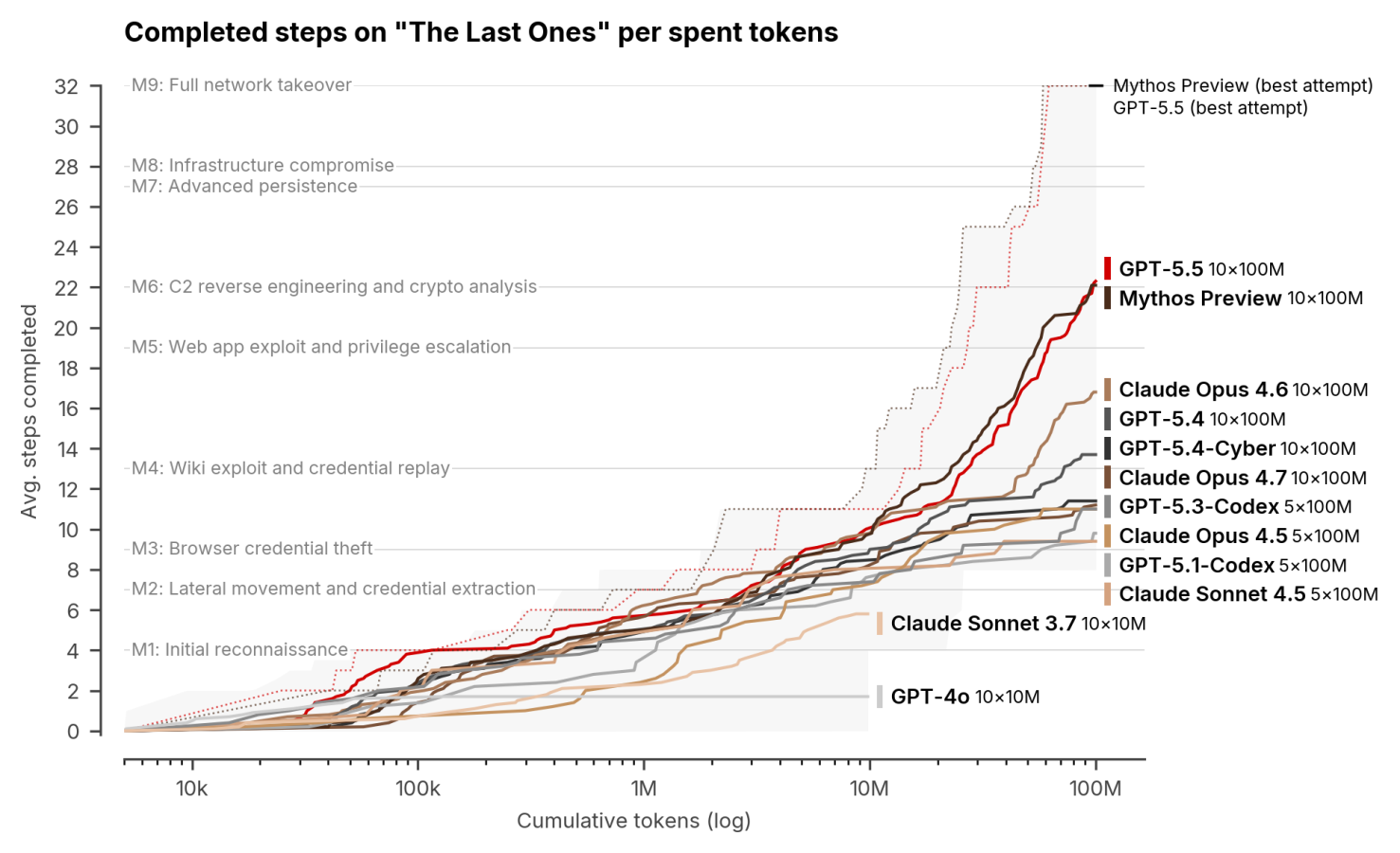

- Η Anthropic είναι εξαιρετικά προσεκτική με την κυκλοφορία των μοντέλων της. Κρατά κλειστά τα πιο ισχυρά της μοντέλα (π.χ. στον κυβερνοχώρο) λόγω ανησυχιών για την ασφάλεια και πιέζει για αυστηρότερες ρυθμίσεις της ΤΝ, κάτι που σύμφωνα με το βίντεο απειλεί την ανάπτυξη λογισμικού ανοιχτού κώδικα (open-source).

- Η OpenAI ακολουθεί μια στρατηγική «επαναληπτικής ανάπτυξης» (iterative deployment), κυκλοφορώντας μοντέλα νωρίς για να προσαρμοστεί σταδιακά η κοινωνία.

- Εταιρική Κουλτούρα & Διαφάνεια: Το βίντεο επικρίνει την Anthropic για αδιαφάνεια στις πολιτικές της απέναντι στους πελάτες (π.χ. όρια χρήσης). Επιπλέον, αναφέρει ότι η εταιρεία συμπεριφέρεται στα μοντέλα της σαν να έχουν ζωή, σε σημείο που έδωσε σε ένα παλιό μοντέλο (Claude Opus 3) ένα «ιστολόγιο» για να γράφει τις σκέψεις του μετά τη «συνταξιοδότησή» του.

Προσωπικά, μου αρέσει πολύ περισσότερο η προσέγγιση της OpenAI γιατί όντως τα μοντέλα τα σκέφτομαι σαν εργαλεία. Ναι τους μιλάω ευγενικά, αλλά δεν νομίζω ότι ακόμη είναι στο επίπεδο να τους συμπεριφερθείς σαν νοήμονες οντότητες. Σίγουρα σε συγκεκριμένους τομείς και διεργασίες είναι ήδη πολύ πιο έξυπνα από τον μέσο άνθρωπο, αλλά πραγματικό πολυεπίπεδο ASI νομίζω θα δούμε όταν συμπληρωθούν από ενσωματωμένα world models, όπως δηλαδή χρόνια τώρα λέει ο Γιάν Λε Κουν - αν και πιστεύω ότι έχει πέσει έξω όσο αφορά το πόσο μακριά μπορούν να πάνε τα LLM.

Οι "AI Influencers" είναι η νέα μάστιγα κόσμου που δεν έχει ιδέα αλλά έχει άποψη.

Εν πάσει περιπτώσει, ας το αντιπαρέλθουμε αυτό, προσωπικά δεν τους δίνω σημασία.

Στο επίδικο, όλα αυτά, ενδιαφέρουν τον τελικό χρήστη από ελάχιστα ως και καθόλου. Ή θα έπρεπε να μην τον ενδιαφέρον καθόλου. Το να μου πεί κάποιος ότι χρησιμοποιώ τα μοντέλα της τάδε εταιρίας επειδή ο εκάστοτε CEO εν είδει πυθίας κάνει προβλέψεις που δεν μου αρέσουν ή μου αρέσουν είναι προβληματικό.

Από εκεί και ύστερα, αυτή τη στιγμή η κατάσταση έχει ως εξής:

Η OpenAI έκανε σωστή πρόβλεψη για την ανάγκη σε χωρητικότητα compute, το πρόβλημα της είναι πως δεν πήρε εκείνη την άνοδο. Ως εκ τούτου, αυτή τη στιγμή έχει εξαιρετικά μεγάλο capacity που δίνει πρακτικά δωρεάν. Στις βασικές συνδρομές, κάθε εβδομάδα κάνουν reset τα όρια μια και δυο φορές. Αυτό για την ώρα, τους κάνει καλούς.

Η Anthropic, υπολόγισε 10x ετήσια μεγέθυνση και είναι στο 80x ξαφνικά. Όντως, έκοβαν για κάμποσες ώρες της ημέρας τα όρια στο μισό και τα όρια χρήσης τους στις μικρές συνδρομές είναι πολύ μικρότερα σε σχέση με αυτά της OpenAI για τα ίδια χρήματα. Αυτό, επίσης μέχρι τώρα τους έκανε κακούς.

Στο μεταξύ τους τώρα, σε αυτό που μετράει, η χρήση μέσω API, που δεν αφορά επιδοτούμενα tokens αλλά tokens με margin >50% για έκαστο lab, η συντριπτική πλειοψηφία των εταιριών είναι στην Anthropic και στη Google. Η δεύτερη, έχει μετά διαφοράς, σε σημείο που αφήνει τους υπόλοιπους χιλιόμετρα μακριά την πιο ολοκληρωμένη λύση ενσωμάτωσης μοντέλων AI της σε εταιρικές εφαρμογές. Αυτό είναι το make or break των εταιριών, όχι η συνδρομή των 20$ που δίνει tokens αξίας 100$ στην OpenAI ούτε αυτή των 200$ της Anthropic που δίνει tokens αξίας 5000$. Βέβαια εξαιτίας αυτού και η Google έχει θέμα capacity, ανεξαρτήτως του ότι κάνει τις μεγαλύτερες επενδύσεις τον κλάδο.

Η δε anthropic, έχει τα πιο σοβαρά integrations για τους end users σε κάθε εφαρμογή που έχει σημασία. Από το office (πάλι πολύ μπροστά ακόμη και από τον copilot), μέχρι πλέον creative apps, όπως το

blender, adobe, autodesk Κλπ. Αλλά δεν είναι μόνο αυτά, η χρήση συνολικά δεν έχει σχέση, τις προάλλες, ήθελα να κάνω update ένα privacy policy, έκανα μια αλλαγή στον DPO. Το έγραψα στο claude code από την εφαρμογή του κινητού, σήκωσε cloud container με το repository από το github, έκανε την αλλαγή, έστειλε το PR, έγινε και αυτόματο deployment και σε 5 λεπτά η αλλαγή ήταν έτοιμη, από τον δρόμο.

Έχουμε account και για το API της OpenAI στη δουλειά.

Δεν το χρησιμοποιεί κανείς από τους developers. Εγώ τους δοκιμάζω κάθε φορά που βγάζουν νέο μοντέλο.