Καλά, χτύπα μου στο Teams αύριο να πεις στον Mythos Tzimisce τι skills θέλεις να έχει ο MCP server και τι data να σερβίρει...

Τεχνητή Νοημοσύνη (AI). Τι είναι, τι ξέρουμε, τι αλλάζει στη ζωή και στον πολιτισμό;

- Thread starter Sonus Naturalis

- Start date

You are using an out of date browser. It may not display this or other websites correctly.

You should upgrade or use an alternative browser.

You should upgrade or use an alternative browser.

Σήμερα ξεκίνησε το Google Cloud next, και είχε κάποια ενδιαφέροντα σημεία σχετικά με την υποδομή που χτίζουν.

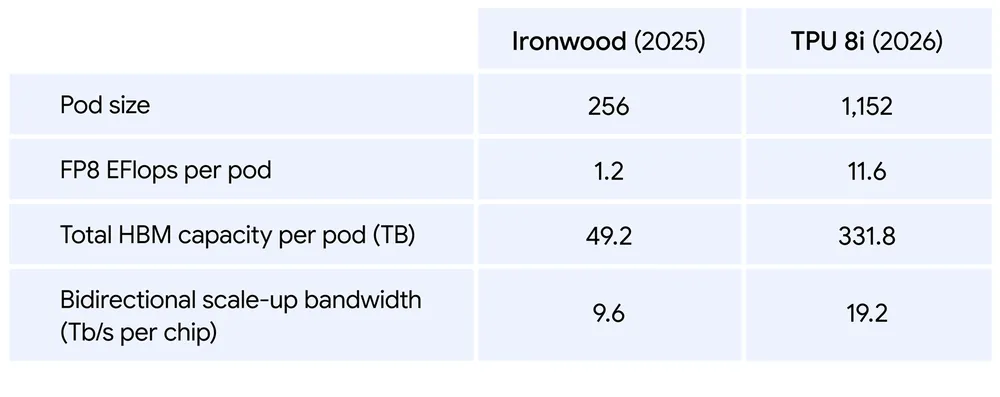

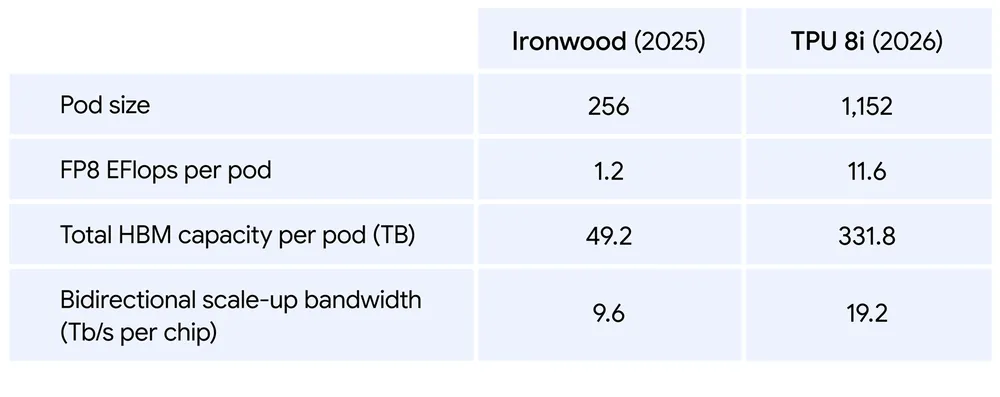

Παρουσίασαν τα νέα TPU, v8 με περίπου τριπλάσες επιδόσεις σε σχέση με την γενιά Ironwolf.

2 TPUs, ένα προσανατολισμένο στην εκπαίδευση μοντέλων και ένα στο Inference, η υποδομή στην οποία τρέχουν.

Υπάρχει πολύ deep dive εάν σας ενδιαφέρει, σε μια γραμμή, μας ενδιαφέρει το pod size επειδή πρακτικά είναι ο σκληρός περιορισμός του μεγέθους ενός μοντέλου που μπορεί να τρέξει σε μεγάλη κλίμακα. Αυτό μας ενδιαφέρει επειδή σήμερα όλα τα μεγάλα Lab βγάζουν μοντέλα MoE, το συνολικό μέγεθος του μοντέλο υποδεικνύει το πόση γνώση έχει εγγενώς, χωρίς να χρειαστεί να ψάξει μέσω εργαλείων. Και στο ίδιο μέγεθος των ενεργών παραμέτρων να μείνουν οι Experts που επικαλείται για να μας απαντήσουν, θα δούμε σημαντική βελτίωση.

blog.google

blog.google

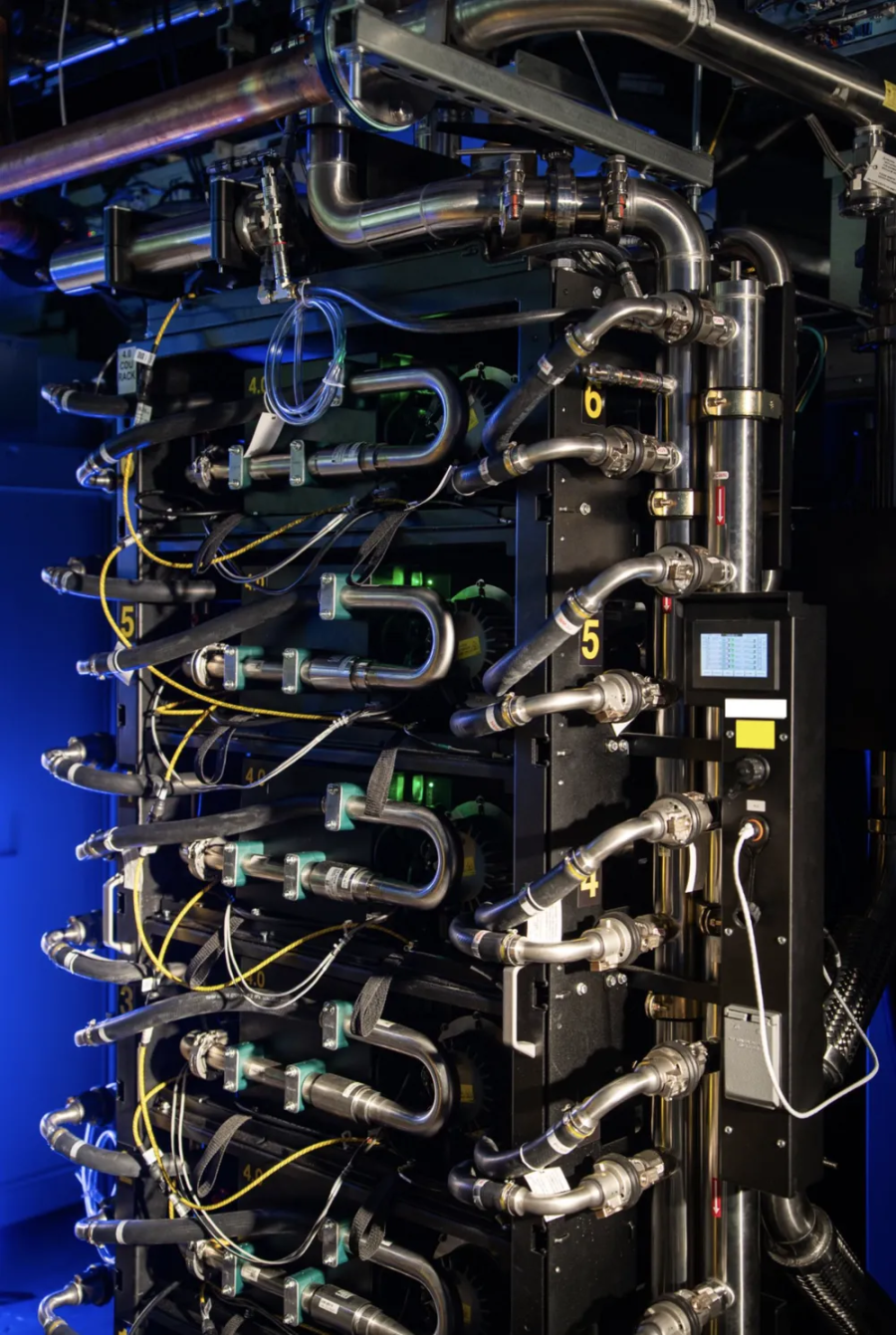

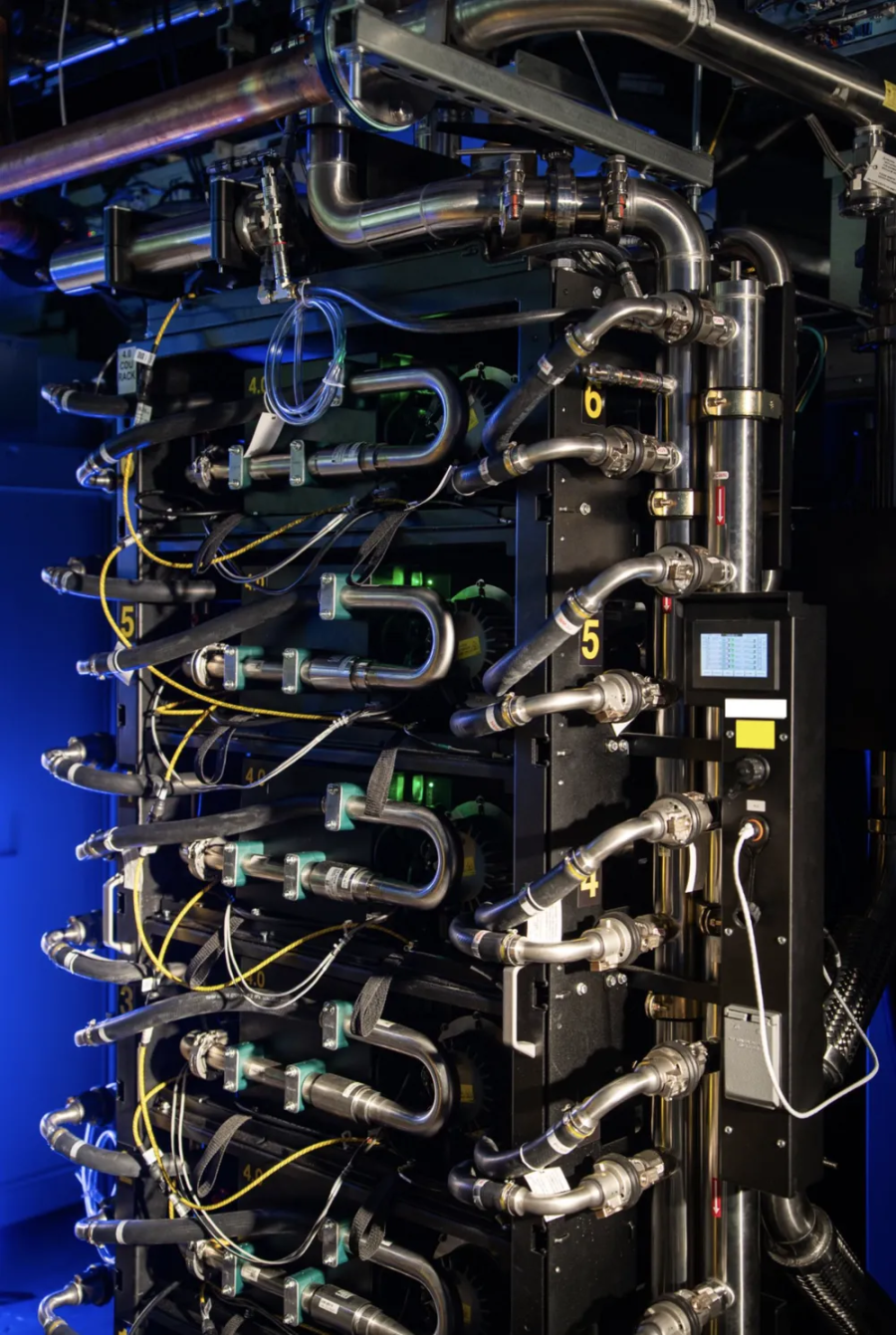

Αυτή είναι η λύση υδρόψυξης που ανέπτυξαν για την υποδομή.

Τέλος, η Nvidia ανακοίνωσε πως η Google αγόρασε 960,000 GPUs της γενιάς Vera Rubin που μόλις παρουσίασαν, τον περασμένο μήνα.

Μόνο η προμήθεια αυτή είναι 2,5 φορές το Stargate της OpenAI και 4 φορές το Colossus της xAI.

Στο NVL72 packaging, αυτό αντιστοιχεί σε 13,300 rack. 220KW το κάθε rack, είναι στα 3GW οι απαιτήσεις χωρίς τη ψύξη και τις ανάγκες του υπόλοιπου datacenter.

Για το 2026, έχουν παραγγείλει εν τω μεταξύ στη Broadcom 4.3εκ. TPUs (v7 κυρίως).

Σε αυτή τη γενιά, η πυκνότητα είναι 64 TPU ανά rack, οπότε 67,000 rack, στα 70KW ανά rack (ναι, είναι εξαιρετικά πιο efficient, εξού μπαίνουν και στον κόπο), 4,7GW.

Για το 2027, θα παραγγείλουν 10εκ TPU v8. Τα κόστη CapEx για το 2026 είναι 180δις$.

Παρουσίασαν τα νέα TPU, v8 με περίπου τριπλάσες επιδόσεις σε σχέση με την γενιά Ironwolf.

2 TPUs, ένα προσανατολισμένο στην εκπαίδευση μοντέλων και ένα στο Inference, η υποδομή στην οποία τρέχουν.

Υπάρχει πολύ deep dive εάν σας ενδιαφέρει, σε μια γραμμή, μας ενδιαφέρει το pod size επειδή πρακτικά είναι ο σκληρός περιορισμός του μεγέθους ενός μοντέλου που μπορεί να τρέξει σε μεγάλη κλίμακα. Αυτό μας ενδιαφέρει επειδή σήμερα όλα τα μεγάλα Lab βγάζουν μοντέλα MoE, το συνολικό μέγεθος του μοντέλο υποδεικνύει το πόση γνώση έχει εγγενώς, χωρίς να χρειαστεί να ψάξει μέσω εργαλείων. Και στο ίδιο μέγεθος των ενεργών παραμέτρων να μείνουν οι Experts που επικαλείται για να μας απαντήσουν, θα δούμε σημαντική βελτίωση.

Our eighth generation TPUs: two chips for the agentic era

An overview of Google’s eighth generation TPUs, built for the agentic era.

Αυτή είναι η λύση υδρόψυξης που ανέπτυξαν για την υποδομή.

Τέλος, η Nvidia ανακοίνωσε πως η Google αγόρασε 960,000 GPUs της γενιάς Vera Rubin που μόλις παρουσίασαν, τον περασμένο μήνα.

Μόνο η προμήθεια αυτή είναι 2,5 φορές το Stargate της OpenAI και 4 φορές το Colossus της xAI.

Στο NVL72 packaging, αυτό αντιστοιχεί σε 13,300 rack. 220KW το κάθε rack, είναι στα 3GW οι απαιτήσεις χωρίς τη ψύξη και τις ανάγκες του υπόλοιπου datacenter.

Για το 2026, έχουν παραγγείλει εν τω μεταξύ στη Broadcom 4.3εκ. TPUs (v7 κυρίως).

Σε αυτή τη γενιά, η πυκνότητα είναι 64 TPU ανά rack, οπότε 67,000 rack, στα 70KW ανά rack (ναι, είναι εξαιρετικά πιο efficient, εξού μπαίνουν και στον κόπο), 4,7GW.

Για το 2027, θα παραγγείλουν 10εκ TPU v8. Τα κόστη CapEx για το 2026 είναι 180δις$.

athlon6401

Supreme Member

- 12 December 2018

- 3,659

Από το Φεβρουάριο μέχρι σήμερα χρησιμοποίησα το chatgpt plus σαν βοηθό / developer για να ολοκληρώσω κάποια project που τα είχα καιρό στο todo list και τα ανέβαλα γιατί δεν είχα το χρόνο να τα κάνω 100% μόνος και δεν έβρισκα κατάλληλο βοηθό. Μέσα σε λιγότερο από τρεις μήνες ήδη ολοκλήρωσα 4 από αυτά και μου μένουν λίγα ακόμα. Ο κώδικας περιλάμβανε php, js, python, lua κτλ. Ήταν πραγματικά σα να είχα ένα βοηθό με πολύ καλές ικανότητες σε όλες αυτές τις γλώσσες. Ναι έκανε και λάθη, έπρεπε να είμαι πάντα αρκετά συγκεκριμένος στο τι ζητάω, αλλά τελικά ήταν απόλυτα επιτυχημένο το εγχείρημα.

Δε ξέρω αν υπάρχει άλλο AI καλύτερο για αυτή τη χρήση αλλά εγώ είμαι πολύ ικανοποιημένος. Ένας βοηθός με αυτές τις ικανότητες θα μου κόστιζε - πέρα από το θέμα της εχεμύθιας και της εμπιστοσύνης - πάνω από 4000-5000 ευρώ για 3 μήνες. Κόστος chatgpt plus, 23 euro το μήνα!

Δε ξέρω αν υπάρχει άλλο AI καλύτερο για αυτή τη χρήση αλλά εγώ είμαι πολύ ικανοποιημένος. Ένας βοηθός με αυτές τις ικανότητες θα μου κόστιζε - πέρα από το θέμα της εχεμύθιας και της εμπιστοσύνης - πάνω από 4000-5000 ευρώ για 3 μήνες. Κόστος chatgpt plus, 23 euro το μήνα!

Γιώργος Κυριακαράκος

Administration Team

- 17 June 2006

- 11,631

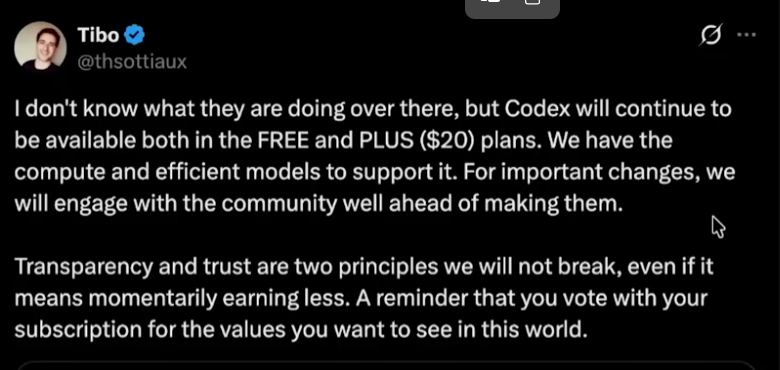

H Anthropic έκοψε το Claude Code στις φθηνές συνδρομές!!!! Θέλεις 100 ευρώ για να έχεις Max και να πάρεις το Claude Code πια.

Μετά το έμμεσο κόψιμο της οικονομικής χρήσης για openclaw έρχεται αυτό. Νομίζω ότι θα χάσουν κόσμο μετά από αυτό.

Τρελή βόμβα...Να δούμε αν θα ακολουθήσει η OpenAI...

Υ.Γ. Νιώθω ότι τις τελευταίες 2 ημέρες το ChatGPT έχει γίνει πιο αργό. Χτύπησα 55 λεπτά για κάτι που θα υπολογίζα στο μισάωρο και 10λεπτα για κάτι που θεωρητικά θα ήταν θέμα λιγότερων λεπτών. Να δούμε αν έχει να κάνει με τα τελικά μαζέματα πριν βγάλουν το 5.5.

Μετά το έμμεσο κόψιμο της οικονομικής χρήσης για openclaw έρχεται αυτό. Νομίζω ότι θα χάσουν κόσμο μετά από αυτό.

Τρελή βόμβα...Να δούμε αν θα ακολουθήσει η OpenAI...

Υ.Γ. Νιώθω ότι τις τελευταίες 2 ημέρες το ChatGPT έχει γίνει πιο αργό. Χτύπησα 55 λεπτά για κάτι που θα υπολογίζα στο μισάωρο και 10λεπτα για κάτι που θεωρητικά θα ήταν θέμα λιγότερων λεπτών. Να δούμε αν έχει να κάνει με τα τελικά μαζέματα πριν βγάλουν το 5.5.

Γιώργος Κυριακαράκος

Administration Team

- 17 June 2006

- 11,631

Νάτα μας...

Βασικά το claude code δουλεύει ακόμη στο IDE μου. Είναι στα σχέδιά της να το κόψει;

Τελευταία δούλευα σε ένα project (θα το βάλω και εδώ) και μου έλυσε τα χέρια.

Θα χρειαζόμουν 4 οθόνες για να κάνω αυτά που θέλω (μία για τον κώδικα, μία με ssh στο rpi, μία με terminal να στέλνω αρχεία και μία να ελέγχω την έξοδο).

Αυτό γιατί η μόνη "είσοδος" στο RPI ήταν το wifi access point που έχω στήσει και ssh από εκεί.

Stateless, δεν παίρνει IP για να κάνεις ssh, δεν έχει πρόσβαση στο internet και δεν ήθελε για κανένα λόγο να μου στήσει σωστά τα nftables.

Άντε να δουλεύεις με tee και journals.

SSH από το terminal και καλό μου claude ξεκίνα το debugging.

- "Έκανα λάθος και έσβησα το directory του project, νόμιζα ότι ήμουν σε άλλο directory." μου κάνει.

- "Είσαι καλά ρε μπρούκλη;" του λέω, "κάνε pull από το git και ξανακάνε τις αλλαγές σου"

- "Δεν απαντάει το git, φαίνεται να μην έχω πρόσβαση στο internet" μου κάνει το σαΐνι.

- "Είδες τώρα βλακάκο γιατί σε έχω χώσει εκεί μέσα; Κάνε τώρα scp σε όλα τα αρχεία από το directory του project ξανά"

Γέλασα, γέλασε, μου χρέωσε καμιά 10αριά χιλιάδες token για τη βλακεία του και πήγαμε παρακάτω.

Βασικά το claude code δουλεύει ακόμη στο IDE μου. Είναι στα σχέδιά της να το κόψει;

Τελευταία δούλευα σε ένα project (θα το βάλω και εδώ) και μου έλυσε τα χέρια.

Θα χρειαζόμουν 4 οθόνες για να κάνω αυτά που θέλω (μία για τον κώδικα, μία με ssh στο rpi, μία με terminal να στέλνω αρχεία και μία να ελέγχω την έξοδο).

Αυτό γιατί η μόνη "είσοδος" στο RPI ήταν το wifi access point που έχω στήσει και ssh από εκεί.

Stateless, δεν παίρνει IP για να κάνεις ssh, δεν έχει πρόσβαση στο internet και δεν ήθελε για κανένα λόγο να μου στήσει σωστά τα nftables.

Άντε να δουλεύεις με tee και journals.

SSH από το terminal και καλό μου claude ξεκίνα το debugging.

- "Έκανα λάθος και έσβησα το directory του project, νόμιζα ότι ήμουν σε άλλο directory." μου κάνει.

- "Είσαι καλά ρε μπρούκλη;" του λέω, "κάνε pull από το git και ξανακάνε τις αλλαγές σου"

- "Δεν απαντάει το git, φαίνεται να μην έχω πρόσβαση στο internet" μου κάνει το σαΐνι.

- "Είδες τώρα βλακάκο γιατί σε έχω χώσει εκεί μέσα; Κάνε τώρα scp σε όλα τα αρχεία από το directory του project ξανά"

Γέλασα, γέλασε, μου χρέωσε καμιά 10αριά χιλιάδες token για τη βλακεία του και πήγαμε παρακάτω.

Εδώ πάντως το FPGA project μου έχει πάει φανταστικά με το Gemini Pro.

Είναι αδιανόητο τι έχω καταφέρει σε λιγότερο από 20 μέρες περιστασιακής ενασχόλησης.

Και όλα αυτά χωρίς να το έχω κάνει καν integrate σε IDE. Με copy-paste κώδικα από εδώ και από εκεί.

Έχω βάλει και το Antigravity και φαίνεται πολύ ωραίο, αλλά για το FPGA project προτιμώ να το δουλεύω στο IDE της Altera.

Είναι αδιανόητο τι έχω καταφέρει σε λιγότερο από 20 μέρες περιστασιακής ενασχόλησης.

Και όλα αυτά χωρίς να το έχω κάνει καν integrate σε IDE. Με copy-paste κώδικα από εδώ και από εκεί.

Έχω βάλει και το Antigravity και φαίνεται πολύ ωραίο, αλλά για το FPGA project προτιμώ να το δουλεύω στο IDE της Altera.

Γιώργος Κυριακαράκος

Administration Team

- 17 June 2006

- 11,631

Αυτό που άλλαξε είναι ότι έγινε πάλι μονόδρομος η OpenAI για συνδρομές κοντά στα 20 ευρώ. Παίζει ξανά χωρίς ανταγωνιστή.

Από την άλλη, αν το χρησιμοποιείς για δουλειά, 100 ευρώ είναι ψίχουλα έτσι και αλλιώς.

Από την άλλη, αν το χρησιμοποιείς για δουλειά, 100 ευρώ είναι ψίχουλα έτσι και αλλιώς.

songless_bird

AVClub Fanatic

Φυσικά δεν μπορώ να παρακολουθήσω αυτά που κάνετε εσείς αλλά χτες έκοψα το chatgpt plus . Μου έσπασε τα νεύρα . Σε κώδικα που είχε τελειώσει το ιδιο δεν μπορούσε να κάνει αλλαγές χωρίς να χαλάει κάτι. Το χαιρέτησα με ένα μπινελίκι, έκανα copy paste τον αρχικό κώδικα στο AI studio , έδωσα το prompt που το chatgpt δεν μπορούσε να ακολουθήσει και μου εδωσε μέσα σε μια ώρα τον σωστό κώδικα και ένα UI λειτουργικοτατο χωρίς μα μου και χωρίς "προτασεις" βελτίωσης.

Δεν ασχολούμαι ξανά με chatgpt ούτε για να φτιάχνω εικόνες...

Δεν ασχολούμαι ξανά με chatgpt ούτε για να φτιάχνω εικόνες...

Γιώργος Κυριακαράκος

Administration Team

- 17 June 2006

- 11,631

Πρώτα από όλα, το μοντέλο για εικόνες που έβγαλε η OpenAI προχθες είναι ότι καλύτερο υπάρχει σήμερα.Φυσικά δεν μπορώ να παρακολουθήσω αυτά που κάνετε εσείς αλλά χτες έκοψα το chatgpt plus . Μου έσπασε τα νεύρα . Σε κώδικα που είχε τελειώσει το ιδιο δεν μπορούσε να κάνει αλλαγές χωρίς να χαλάει κάτι. Το χαιρέτησα με ένα μπινελίκι, έκανα copy paste τον αρχικό κώδικα στο AI studio , έδωσα το prompt που το chatgpt δεν μπορούσε να ακολουθήσει και μου εδωσε μέσα σε μια ώρα τον σωστό κώδικα και ένα UI λειτουργικοτατο χωρίς μα μου και χωρίς "προτασεις" βελτίωσης.

Δεν ασχολούμαι ξανά με chatgpt ούτε για να φτιάχνω εικόνες...

Δεύτερον, όλα τα έκανες σε ένα chat; Για να είσαι αποτελεσματικός μετά από κάποιο αριθμό μηνυμάτων σε ένα thread, πρέπει να ανοίξεις άλλο και να ξαναξεκινήσεις. Θα δεις πόσο καλύτερα θα πάει.

Τέλος αν ήθελες κώδικα, γιατί δεν χρησιμοποίησες το Codex? Είναι ακριβώς για αυτό το usecase και πια κάνει και auto-compaction (δεν είναι τεχνικά το ίδιο αλλά αναλογικά θα μπορούσε κάποιος να πει ότι είναι το ίδιο με το να ανοίγεις νεό chat).

Νάτα μας...

Βασικά το claude code δουλεύει ακόμη στο IDE μου. Είναι στα σχέδιά της να το κόψει;

Όχι. Έκαναν μια δοκιμή στο 2% των νέων εγγραφών για το πως θα το πάρουν και μετά από τη τραγωδία του PR, το πήραν πίσω τελείως.

songless_bird

AVClub Fanatic

Πρώτα από όλα, το μοντέλο για εικόνες που έβγαλε η OpenAI προχθες είναι ότι καλύτερο υπάρχει σήμερα.

Δεύτερον, όλα τα έκανες σε ένα chat; Για να είσαι αποτελεσματικός μετά από κάποιο αριθμό μηνυμάτων σε ένα thread, πρέπει να ανοίξεις άλλο και να ξαναξεκινήσεις. Θα δεις πόσο καλύτερα θα πάει.

Τέλος αν ήθελες κώδικα, γιατί δεν χρησιμοποίησες το Codex? Είναι ακριβώς για αυτό το usecase και πια κάνει και auto-compaction (δεν είναι τεχνικά το ίδιο αλλά αναλογικά θα μπορούσε κάποιος να πει ότι είναι το ίδιο με το να ανοίγεις νεό chat).

Δεν ασχολούμαι με εικόνες

Το έχω ξεκινήσει ως project γιατί σε απλό chat θα χτυπούσε όριο και θα έπρεπε να ανοίξω νέο έτσι κι αλλιώς. Μου το είχε κάνει παλαιότερα και για έναν περίεργο λόγο ενώ κρατάει πληροφορίες του ιστορικού σε νέα Chat ήταν σαν να το ξεκινούσα από την αρχή και να του μάθαινα ότι είχε φτιάξει το ίδιο ξανά...

Όταν έβαλα το Plus το έκανα στο codex . Αλλά τώρα ζητούσα απλές αλλαγές στο UI . Υπήρχε ήδη η δομή και απλά έπρεπε να συμπληρώσει ένα υπομενου και αυτό "εσπαγε" μέχρι και τα pins που είχα οριοθετησει στο κώδικα για το raspberry για τον σενσορα. Σαν να ήθελε να μου ξοδέψει το ημερήσιο όριο χωρίς να κάνω δουλειά... Δεν έβγαλα άκρη μαζί του.

Πήρα όλο το project στο AI studio της Google και οχι μόνο έβαλα το υπομενου αλλά ολοκληρώθηκε και το project . Δεν ξέρω αν έχει σημασία αλλά χρειάστηκε 140.000 tokens και 1 ωρα για να κάνει αυτό που με το chatgpt παλευα μέρες...

Γιώργος Κυριακαράκος

Administration Team

- 17 June 2006

- 11,631

Το θέμα είναι ότι δεν έχουν την απαιτούμενη υπολογιστική υποδομή για αυτά που προσφέρουν και τους πελάτες που έχουν. Και έχουν κάνει διάφορα τον τελευταίο καιρό για να το σώσουν, αλλά από ότι φαίνεται έχουν όντως σοβαρό πρόβλημα.Όχι. Έκαναν μια δοκιμή στο 2% των νέων εγγραφών για το πως θα το πάρουν και μετά από τη τραγωδία του PR, το πήραν πίσω τελείως.

Ίσως και όλη η κατάσταση με το Mythos να έχει επηρρεαστεί από το απλό ότι δεν έχουν την υπολογιστική υποδομή να το προσφέρουν όπως πρέπει σε αυτούς που δεδομένα θα πληρώσουν για αυτό. Ακόμη και να μην ισχύει δεν είμαι ο μόνος που έχει αρχίσει να το σκέφτεται μετά από όλα αυτά που γίνονται...

Αυτή τη στιγμή, μόνο η OpenAI δεν έχει πρόβλημα στο compute και αυτό επειδή είχε σχεδιάσει για ανάπτυξη που δεν έχει. Σε σημείο που έκοψε τα επενδυτικά πλάνα.

Η anthropic έχει ανάπτυξη που δεν είχε σχεδιάσει και η Google παρότι δίνει τα περισσότερα χρήματα και έχει τη μεγαλύτερη υποδομή με διαφορά, επίσης έχει εξαιρετικά σοβαρό πρόβλημα.

Η anthropic έχει ανάπτυξη που δεν είχε σχεδιάσει και η Google παρότι δίνει τα περισσότερα χρήματα και έχει τη μεγαλύτερη υποδομή με διαφορά, επίσης έχει εξαιρετικά σοβαρό πρόβλημα.

Kosh

AVClub Fanatic

Η κινεζική DeepSeek περνά στην αντεπίθεση με νέο μοντέλο ΑΙ που προκαλεί OpenAI και Anthropic

Η DeepSeek παρουσίασε τα νέα μοντέλα V4 Flash και V4 Pro προκαλώντας νέες ανησυχίες στις ΗΠΑ

Γιώργος Κυριακαράκος

Administration Team

- 17 June 2006

- 11,631

Γιώργος Κυριακαράκος

Administration Team

- 17 June 2006

- 11,631

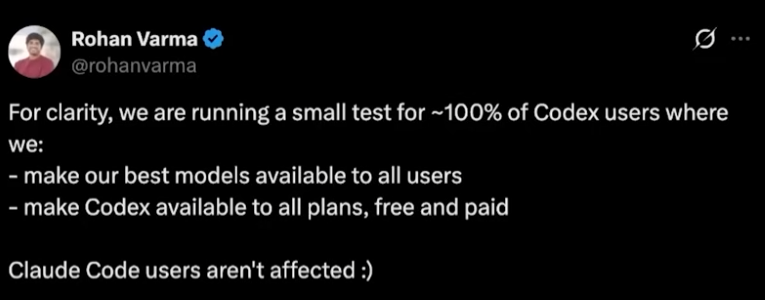

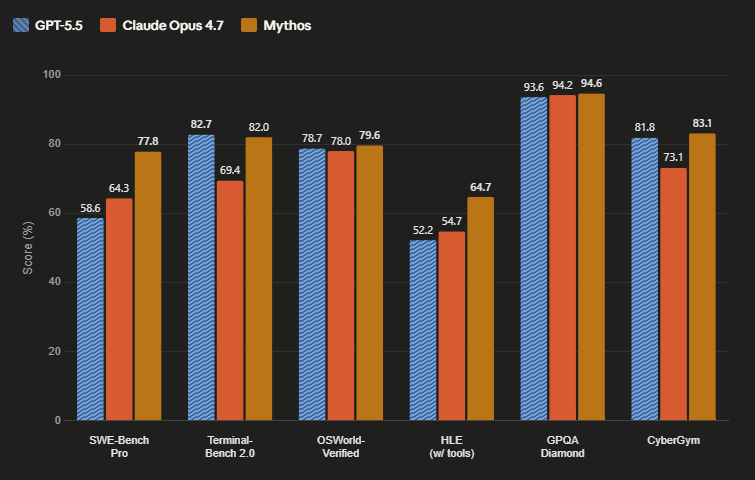

Διαβάζω σιγά σιγά για το ChatGPT 5.5 και τις νέες δυνατότητες που φέρνει. Και αυτές από ότι καταλάβαίνω δεν είναι τα καλύτερα σκορ στα benchmarks, αλλά το τι μπορεί να κάνει τώρα το Codex.

Με απλά λόγια η OpenAI διαθέτει πλέον μια αξιόπιστη διαδρομή προς κάθε λογισμικό που διαθέτει γραφικό περιβάλλον διεπαφής (GUI), και το κατάφερε αυτό χωρίς να χρειαστεί τη συνεργασία ούτε ενός προμηθευτή. Ο πράκτορας (agent) απλώς χειρίζεται τη διεπαφή που χειριζόμαστε ήδη εμείς.

Σκεφτείτε τι αλλάζει με αυτό. Πριν από έξι μήνες, οποιοδήποτε λογισμικό δεν διέθετε API βρισκόταν εξ ολοκλήρου εκτός της συζήτησης περί αυτοματισμού. Εσωτερικά ταμπλό ελέγχου (dashboards), πύλες παλαιών προμηθευτών (legacy portals), η εφαρμογή που έφτιαξε μια εταιρεία το 2019 και δεν συντήρησε ποτέ. Αυτό το λογισμικό μόλις επέστρεψε στο προσκήνιο, μέσα από μια πόρτα που δεν απαιτεί την άδεια κανενός για να ανοίξει.

Η Anthropic έκανε το ίδιο στοίχημα όσον αφορά την έξοδο των πρακτόρων από το πλαίσιο του προγραμματισμού (coding box), αλλά μέσω δομημένων διεπαφών που εξαρτώνται από το αν το οικοσύστημα θα αναπτυχθεί εξαρχής για πράκτορες. Και τα δύο εργαστήρια κατευθύνονται στον ίδιο προορισμό. Οι διαδρομές που επέλεξαν είναι θεμελιωδώς διαφορετικές, και αυτή η διαφορά καθορίζει σε ποιο λογισμικό μπορούν πραγματικά να έχουν πρόσβαση οι πράκτορές σας σήμερα.

ΑΝ δουλέψει σωστά και γρήγορα το νέο codex, νομίζω θα γυρίσει πάλι η πλάστιγγα προς την OpenAI. Πρακτικά δεν θα χρειάζεσαι καν MCP Servers...Αυτό και αν είναι άλμα σε επίπεδο λίγων εβδομάδων. Το ChatGPT 5.4 βγήκε 5 Μαρτίου για να θυμόμαστε λίγο. Πείτε μου εσείς ότι δεν έχουμε μπει στο singularity...

Με απλά λόγια η OpenAI διαθέτει πλέον μια αξιόπιστη διαδρομή προς κάθε λογισμικό που διαθέτει γραφικό περιβάλλον διεπαφής (GUI), και το κατάφερε αυτό χωρίς να χρειαστεί τη συνεργασία ούτε ενός προμηθευτή. Ο πράκτορας (agent) απλώς χειρίζεται τη διεπαφή που χειριζόμαστε ήδη εμείς.

Σκεφτείτε τι αλλάζει με αυτό. Πριν από έξι μήνες, οποιοδήποτε λογισμικό δεν διέθετε API βρισκόταν εξ ολοκλήρου εκτός της συζήτησης περί αυτοματισμού. Εσωτερικά ταμπλό ελέγχου (dashboards), πύλες παλαιών προμηθευτών (legacy portals), η εφαρμογή που έφτιαξε μια εταιρεία το 2019 και δεν συντήρησε ποτέ. Αυτό το λογισμικό μόλις επέστρεψε στο προσκήνιο, μέσα από μια πόρτα που δεν απαιτεί την άδεια κανενός για να ανοίξει.

Η Anthropic έκανε το ίδιο στοίχημα όσον αφορά την έξοδο των πρακτόρων από το πλαίσιο του προγραμματισμού (coding box), αλλά μέσω δομημένων διεπαφών που εξαρτώνται από το αν το οικοσύστημα θα αναπτυχθεί εξαρχής για πράκτορες. Και τα δύο εργαστήρια κατευθύνονται στον ίδιο προορισμό. Οι διαδρομές που επέλεξαν είναι θεμελιωδώς διαφορετικές, και αυτή η διαφορά καθορίζει σε ποιο λογισμικό μπορούν πραγματικά να έχουν πρόσβαση οι πράκτορές σας σήμερα.

ΑΝ δουλέψει σωστά και γρήγορα το νέο codex, νομίζω θα γυρίσει πάλι η πλάστιγγα προς την OpenAI. Πρακτικά δεν θα χρειάζεσαι καν MCP Servers...Αυτό και αν είναι άλμα σε επίπεδο λίγων εβδομάδων. Το ChatGPT 5.4 βγήκε 5 Μαρτίου για να θυμόμαστε λίγο. Πείτε μου εσείς ότι δεν έχουμε μπει στο singularity...

Γιώργος Κυριακαράκος

Administration Team

- 17 June 2006

- 11,631

Ναι όσο περισσότερο διαβάζω, τόσο και άλλοι δείχνουν προς τα εκεί.

- Ο Greg Brockman λέει ξεκάθαρα ότι το νέο Codex είναι ένα μεγάλο βήμα που φέρνει πιο κοντά το “super app” της OpenAI που θα κάνει τα πάντα μόνο του.

- Ο Jakub Pachocki είπε ότι πιστεύει ότι τα τελευταία 2 χρόνια η πρόοδος ήταν εκπληκτικά αργή (!!! μας κοροϊδεύει;;;;!!!). Και συνεχίζει ότι βλέπουμε σημαντικές βελτιώσεις στο βραχυπρόθεσμο και τεράστιας σημασίας βελτιώσεις στο μεσοπρόθεσμο (εγώ διαβάζω ASI...)

techcrunch.com

techcrunch.com

Υ.Γ. Πως να νιώθει άραγε ο Musk που το όνειρό του ήταν το "Everything App" δηλαδή αυτό που πάει να φτιάξει τώρα πρώτη η OpenAI...

- Ο Greg Brockman λέει ξεκάθαρα ότι το νέο Codex είναι ένα μεγάλο βήμα που φέρνει πιο κοντά το “super app” της OpenAI που θα κάνει τα πάντα μόνο του.

- Ο Jakub Pachocki είπε ότι πιστεύει ότι τα τελευταία 2 χρόνια η πρόοδος ήταν εκπληκτικά αργή (!!! μας κοροϊδεύει;;;;!!!). Και συνεχίζει ότι βλέπουμε σημαντικές βελτιώσεις στο βραχυπρόθεσμο και τεράστιας σημασίας βελτιώσεις στο μεσοπρόθεσμο (εγώ διαβάζω ASI...)

OpenAI releases GPT-5.5, bringing company one step closer to an AI 'super app' | TechCrunch

OpenAI says its latest model offers increased capabilities across a broad variety of categories.

Υ.Γ. Πως να νιώθει άραγε ο Musk που το όνειρό του ήταν το "Everything App" δηλαδή αυτό που πάει να φτιάξει τώρα πρώτη η OpenAI...